Data Warehousing ist wahrlich nicht neu. Schließlich gibt es Analysesysteme seit es Datenverarbeitung gibt. Doch mit der Verwendung etablierter BI Werkzeuge wächst die Bedeutung der Datenqualität, da keine programmierte Schicht die Inhalte „richtig“ rücken kann.

Mit den relationalen Datenbanken erreichte Anfang der 80er Jahre eine wahre Innovation den Markt, war doch mit einem SQL-Select-Befehl bereits ein Grossteil der Arbeit für eine Auswertung erledigt. Und mit rDBMS kamen auch Werkzeuge, die eine formatierte Ausgabe der gelesenen Daten ermöglichten. Damit waren Auswertungen einfacher und schneller zu erzeugen, und zwar ohne Programmierkenntnisse. Die Demokratisierung von Unternehmensinformationen konnte beginnen. Ein weiterer, wichtiger Schritt war der Siegeszug des PCs, und mit ihm die rasche Verbreitung von Office-Produkten. Fachanwender konnten gänzlich unabhängig von der zentralen IT Daten auswerten und grafisch darstellen, seien es Daten, die aus OLTP Systemen abgezogen wurden, oder manuell erfasste Daten – Anwendungen wie MS Excel oder MS Access machten es möglich. Alles ging schnell und erhöhte die dringend erforderliche Flexibilität in den Entscheidungsprozessen. Was wollte man mehr?

Wettbewerbsvorsprung dank Datenintegration

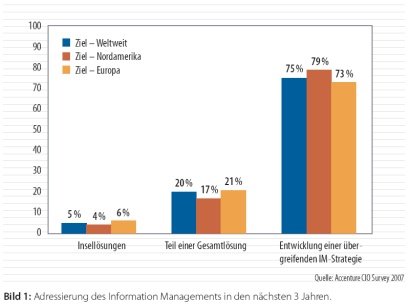

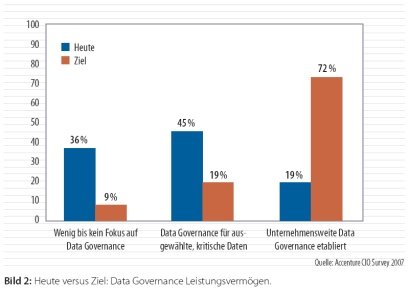

Aber schon lange hat sich in den meisten Unternehmen Ernüchterung breit gemacht. Denn zur Demokratisierung von Information reicht eben nicht nur eine technische Infrastruktur aus, die den Zugriff auf und die hübsche Aufbereitung von Unternehmensdaten ermöglicht. Welches Unternehmen kennt nicht das Problem, dass vermeintlich gleiche Kennzahlen in verschiedenen Auswertungen voneinander abweichen? Nicht nur, dass Entscheidungen auf Basis von unterschiedlichen oder gar falschen Informationen getroffen werden und damit der Unternehmenserfolg potenziell gefährdet wird. Die Kosten, die mit der vielfach im gesamten Unternehmen verteilten Integration und Aufbereitung von unzähligen Kopien der Unternehmensdaten entstehen, sind immens. Regulatorische Anforderungen machen es zudem erforderlich, die Aufbereitung und Verwendung von Unternehmensdaten nachvollziehbar zu gestalten. Einer Accenture-Studie aus dem Jahr 2007 zufolge planen 75 Prozent aller Teilnehmer in den nächsten drei Jahren eine übergreifende Information Management (IM) Strategie zu entwickeln. 62 Prozent versprechen sich von der Integration ihrer Unternehmensdaten vor allem einen Wettbewerbsvorsprung.

Information Management

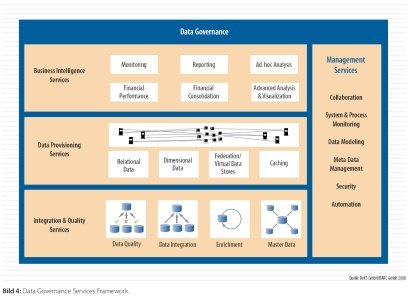

Was aber gehört zu einer solchen IM Strategie dazu und welche Voraussetzungen muss man im Unternehmen schaffen, um sie zu erreichen? Eine vermeintlich einfache Grundvoraussetzung, die jedoch erfahrungsgemäß sehr schwierig zu erreichen ist, ist eine inhaltlich fundierte und verbindliche Kommunikation zwischen Business und IT sicherzustellen. Das Data Warehouse als Basis der analytischen Systeme kann nur dann einen wahren Mehrwert liefern, wenn es die Geschäftswelt des Unternehmens entsprechend den analytischen Anforderungen korrekt und nutzungsfreundlich abbildet. Hier spricht man häufig von der einen zentralen Quelle der Wahrheit (Single Point of Truth). Schließlich greifen BI Systeme direkt und ohne individuell programmierte Schicht direkt auf diese „Wahrheit“ zu. Die Qualität ihrer Aussagen steht und fällt also mit der Qualität der Datenbasis, sowohl inhaltlich als auch bezüglich ihrer Darstellung in Formder Datenmodelle. Das kann in der Konsequenz nur heißen, dass analytische Datenmodelle von Fachanwendern und IT gemeinsam erstellt werden müssen. Das betrifft ebenso die Definition der Regeln zur Zusammenführung der Daten aus den operativen und sonstigen Datenquellen in eine integrierte, analytische Datenbasis. Zur Unterstützung bei der Datenanalyse hat sich die Verfügbarkeit dieser Informationen im Sinne eines Glossars bewährt. Eine nutzungsfreundliche Abbildung der Daten wird jedoch nicht nur durch die fachlichen Fragestellungen bestimmt. Auch die BI Werkzeuge, zur Unterstützung verschiedener analytischer Anforderungen häufig in vielfacher Ausprägung im Einsatz, müssen an diesen Prozessen ausgerichtet und entsprechend konfiguriert werden. Manche Aufgabenstellungen erfordern zusätzliche Workflow-Unterstützung. Um konsistente Informationsverteilung im Unternehmen sicherzustellen, haben sich zudem Standardauswertungen bewährt, für die es eine entsprechende Verteilungsinfrastruktur bedarf. Insgesamt also auch auf technischer und methodischer Ebene eine Integrationsaufgabe.

Business Intelligence Competence Center

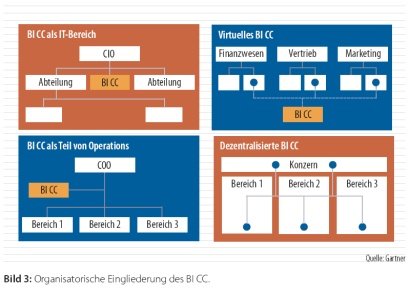

Die Lösung dieser Anforderungen wird derzeit gerne mit dem Begriff „Business Intelligence Competence Center“ (BI CC) zusammengefasst. Ein BI CC hat zur Aufgabe, Strategien und Prioritäten rund um Business Intelligence zu entwickeln und deren Umsetzung sicherzustellen. Dazu zählt auch die zentrale Steuerung der konkreten Datennutzung im Sinne eines Enterprise Information Governance. Kniffelig kann es sich gestalten, wie ein BI CC in die Unternehmensorganisation eingegliedert wird. Die notwendige Institutionalisierung der Zusammenarbeit zwischen Fachbereichen und IT bringt es mit sich, dass das BI CC sowohl mit fachlichem als auch technischem Expertenwissen bestückt sein muss. Hier gilt Praxisbezug als Erfolgsfaktor, weshalb das BI CC nicht zum „Elfenbeinturm“ verfallen darf. Gleichzeitig sollte die Wahl der Aufbauorganisation für das BI CC die strategische Datenmanagement- und BI- Strategie des Unternehmens widerspiegeln. Die Themen, die ein BI CC zu stemmen hat, sind inhaltlich und technologisch komplex, die Abstimmungsprozesse im Unternehmen können langwierig sein. Regulatorische Vorgaben erfordern in vielen Fällen ein formales Change Management. Bei der Gestaltung der Ablauforganisation ist daher Sorge zu tragen, dass die im analytischen Bereich so dringend erforderliche Flexibilität nicht auf der Strecke bleibt. Ansonsten werden die Business Analysten weiterhin auf ihre Office-Suite zurückgreifen und Information Governance Bemühungen werden im Keim erstickt. Dazu gehört vor allem die Unterstützung der Poweruser, die im Rahmen ihrer explorativen Analysen und der Unterstützung des Topmanagements regelmäßig eine kurzfristige Integration neuer oder veränderter Daten benötigen. Diese Anforderungen mit den herkömmlichen Veränderungs- und Freigabe-Prozessen der IT- Entwicklung zu adressieren wäre unglücklich. Vielmehr muss es Lösungen geben, die beispielsweise die Pflege von analytischen Stammdaten in einem flexiblen aber gleichzeitig auditierbaren Prozess ermöglichen. Ein entsprechender Wandel ist bei den BI Lösungsherstellern bereits zu beobachten. Hatten viele der Vendoren lange Zeit für die Abschottung des Data Warehouse plädiert, stellen sie sich zunehmend den Forderungen der Fachanwender nach mehr Flexibilität in der Business Intelligence Umgebung. So wird man in der nächsten Hauptversion der IBM Cognos BI Plattform, die in diesem Herbst erscheinen soll, die Pflege der analytischen Stammdatenmit einer neuen Lösung adressiert sehen.

Leistungsfähigeres Framework

Technologiemuss aber auch in weiteren Bereichen mit den veränderten Anforderungen an globale und kurzfristig zu bedienende Geschäftsprozesse Schritt halten. Hierfür ist das Data Governance Services Framework zu erweitern. Fachanwender wollen sich nichtmehrmit Fragestellungen einer schlechten Antwortzeit, laut BI Survey (http://www.bisurvey.com/) seit vielen Jahren das von Fachanwendern am häufigsten genannte Problem bei analytischen Anwendungen, auseinandersetzen müssen. Das Framework muss leistungsfähige Datenspeicher transparent für Konsumenten integrieren können. Dabei sollte es möglichst verborgen bleiben, wenn zur Unterstützung verschiedener Auswertungsanforderungen heterogene Technologien zum Einsatz kommen und die Daten dadurch in verschiedenen Kopien vorliegen – das Framework sollte den Zugriff steuern. Zu den erweiterten Anforderungen gehört aber auch eine Integration unstrukturierter Daten. Während lediglich 38 Prozent der Befragten aktuell angeben, unstrukturierte Daten in ihre Analysen zu integrieren, planen das der Accenture-Studie zufolge 75 Prozent für die nahe Zukunft. Das betrifft nicht nur das Information Management. Gerade auch Suchfunktionenmüssen zukünftig stärker eine integrierte Sicht auf alle verfügbaren Unternehmensinformationen bieten und nicht auf die BI Umgebung beschränkt sein. Zur Unterstützung des Performance Management Prozesses im Unternehmen bedarf es darüber hinaus kollaborativer Fähigkeiten, die den Informationsaustausch zwischen den am Prozess involvierten Menschen sicherstellt, wie auch deren Dokumentation.

Fazit

So wird das Data Governance Services Framework komplexer, und die Aufgaben, die ein BI Competence Center zu stemmen hat ebenso. Das Information Governance wird sich zukünftig auf unstrukturierte Daten erstrecken müssen, und die Grenzen zwischen den analytischen und operativen Welten werden zunehmend verwässern, womit auch das Governance in Zukunft zur Systemunabhängigen Aufgabe werden muss. Business Intelligence im Unternehmen abzuschotten wäre aber die falsche Antwort. Immer mehr Unternehmen sehen Enterprise Information Governance als eine Notwendigkeit; ohne Flexibilität wird aber in der globalisierten Geschäftswelt kein Unternehmen überleben können. Die richtige Ausgewogenheit zu erreichen ist der Schlüssel zum Erfolg.

JACQUELINE BLOEMEN

Diesen Artikel finden Sie auch in der Ausgabe Oktober 2008 des it management.